Screaming frog - jak korzystać z narzędzia

Spis treści:

- Czym jest crawler stron www?

- Jak działa Screaming Frog?

- Interfejs narzędzia Screaming Frog?

- Jakie parametry danych warto analizować?

- Kiedy Screaming Frog jest przydatny?

- Cykliczne porównywanie danych

- Wizualizacja danych

- Podsumowanie

Czym jest crawler stron www?

Przed opisywaniem funkcji oraz schematu działania Screaming Frog'a - warto wspomnieć w kilku słowach o idei korzystania z crawlerów. Tak jak wcześniej wspominałem, niezbyt optymalnym sposobem na analizę strony jest jej naoczne przeklikiwanie. Oczywiście należy to robić i sprawdzać najbardziej istotne widoki strony internetowej, jednak trzeba pamiętać o tym, że części elementów nie dostrzeżemy w ten sposób i że nie można tylko na tym opierać analizy SEO serwisu.

Kolejnym ważnym aspektem analiz jest analizowanie proporcji występowania pewnych błędów. Podczas naocznego przeklikiwania serwisu możemy dostrzec nieprawidłowości w budowie serwisu, ale ciężko byłoby ocenić, jak duża to skala i na tej podstawie założyć hipotezę o negatywnym wpływie tego elementu na widoczność serwisu. Crawlery takie jak Screaming Frog nie tylko dokładnie sprawdzają serwis - podstrona po podstronie - ale i tworzą statystyki związane ze stroną.

Jak działa Screaming Frog?

Crawler Screaming Frog jest narzędziem desktopowym - działa poprzez instalację oprogramowania na komputerze. Oprogramowanie korzystając z zasobów naszego komputera oraz dostępu do internetu (z naszego PROXY) - odczytuje kod podstron analizowanego serwisu oraz dokonuje przejść pomiędzy podstronami z użyciem linków <a href>. Crawler SF podczas odczytywania stron i nawigowania po nich działa w sposób analogiczny do crawlerów Google.

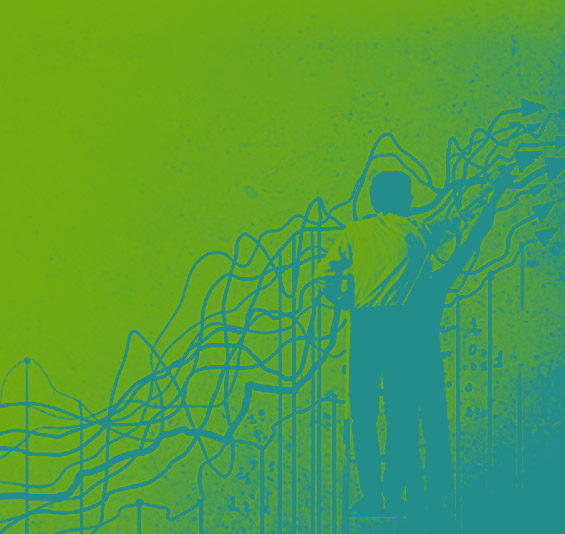

Skoro znamy już teorię, to warto wspomnieć o praktycznym korzystaniu z interfejsu crawlera. Zbierania danych można rozpocząć na kilka sposobów.

Zazwyczaj korzysta się z 2 trybów - Spider (poruszanie się po stronie robotem internetowym po linkach w analizowanym serwisie) oraz List (poruszanie się tylko i wyłącznie w obrębie adresów wylistowanych). Warto także skorzystać z trybu Compare, który jest przydatny podczas cyklicznych analiz i porównania efektów analiz - tryb szczególnie przydatny przy weryfikowaniu tego, co zmienili klienci po wykonanych audytach SEO.

Interfejs narzędzia Screaming Frog?

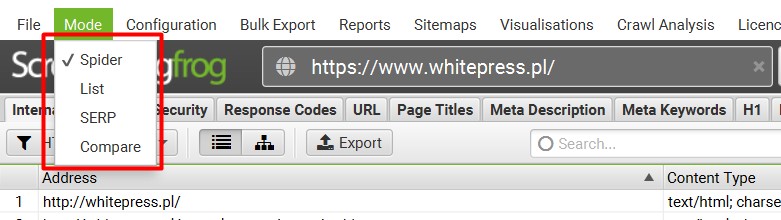

Screaming Frog jest narzędziem wyjątkowo popularnym wśród specjalistów SEO. Przetwarza podczas swojej pracy ogromną ilość danych, a wyniki przedstawia w postaci tabel:

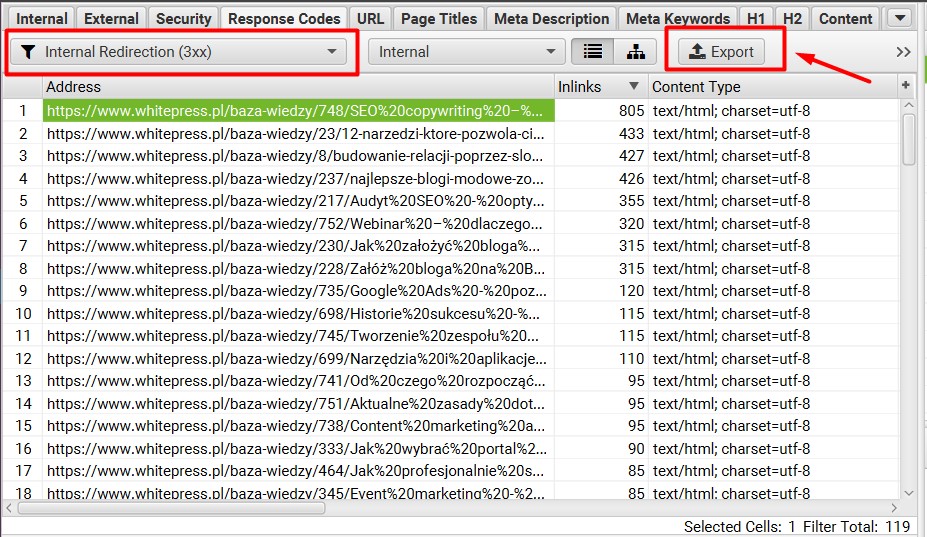

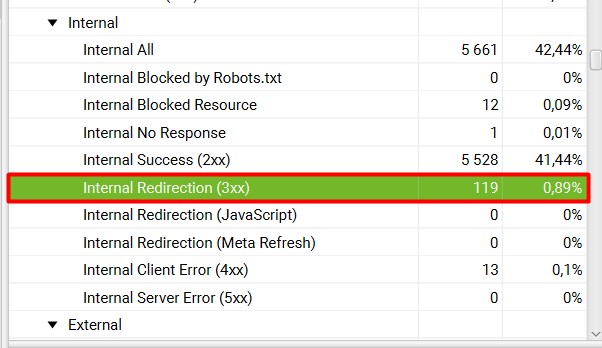

Danych jest wiele, ale są one podzielone na istotne sekcje - takie jak np. Internal, Response Codes czy też Page Titles.

Każda z sekcji posiada dane w postaci tabeli - np.:

Zebrane i odseparowane w ten sposób dane - możemy wygodnie wyeksportować do Excela, który jest jednym z ulubionych narzędzi każdego profesjonalnego SEOwca :)

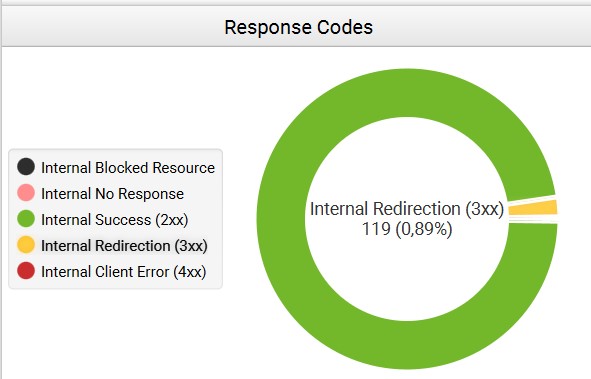

Oprócz samych danych mamy również informacje o ich ilości i proporcjach - przydatne przy podejmowaniu decyzji o priorytecie wdrożeń oraz podczas ilustrowania skali problemu.

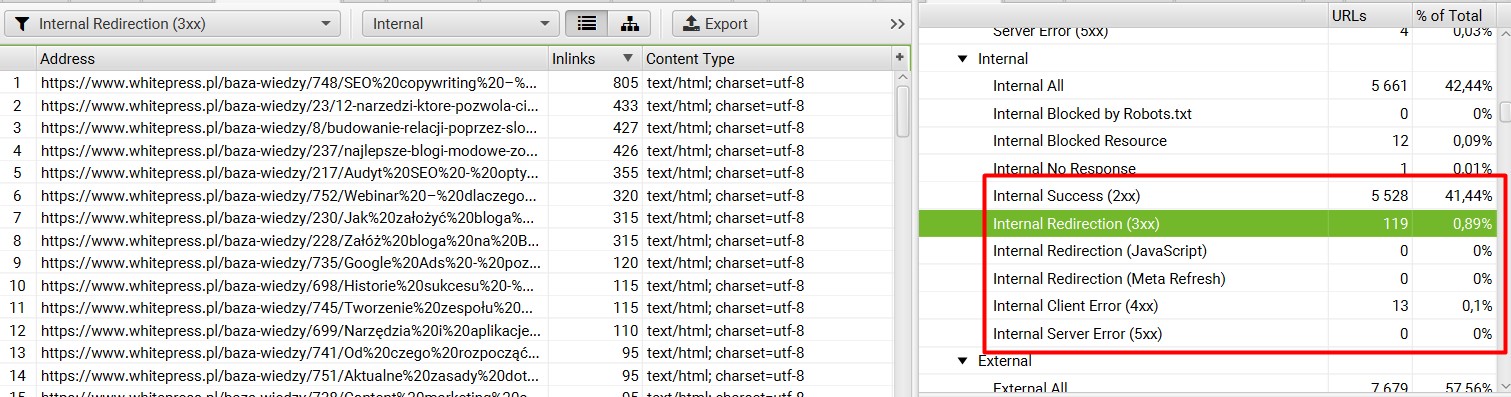

W przypadku, gdy skala w/w przekierowań w linkowaniu wewnętrznym jest dużo większa, niż tutaj przedstawione 0,89% - w czytelny sposób można przedstawić klientowi potrzebę zajęcia się tym problemem.

Jakie parametry danych warto analizować?

W przypadku analiz SEO warto zwracać uwagę na elementy wpływające na widoczność i na podstawie swojej wiedzy i doświadczenia - wybrać te, które mają największy wpływ. Każdy z nas może potrzebować odmiennej funkcjonalności tego narzędzia. Do często weryfikowanych elementów strony należą m.in.:

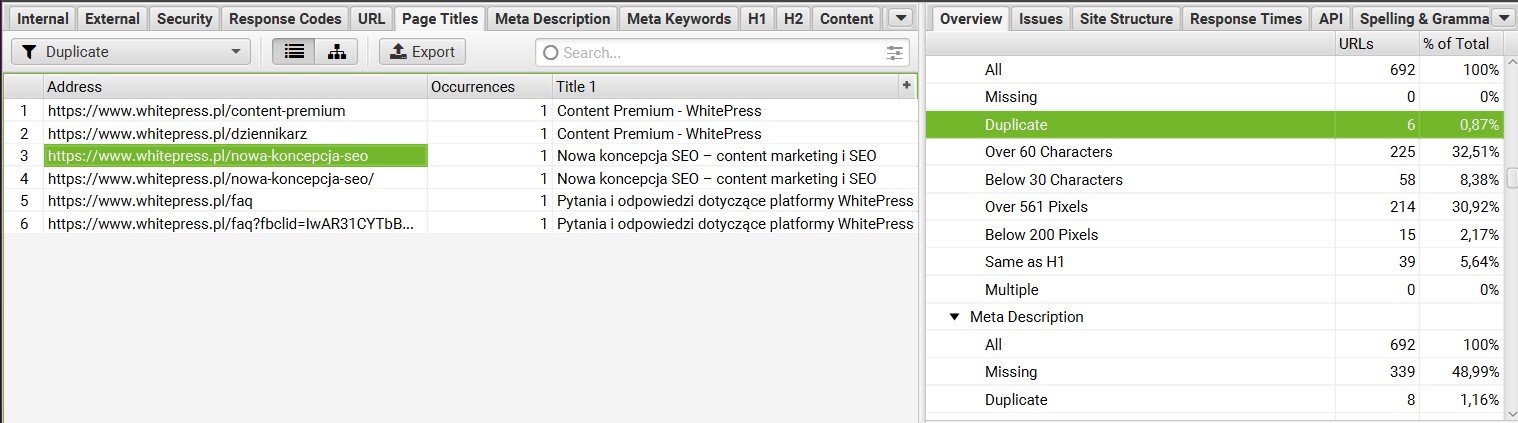

Tytuły podstron

Dzięki takiej analizie możemy dostrzec ustawiony suffix w meta title oraz zauważyć na podstawie duplikacji tego elementu - te same podstrony, ale pod innymi adresami URL.

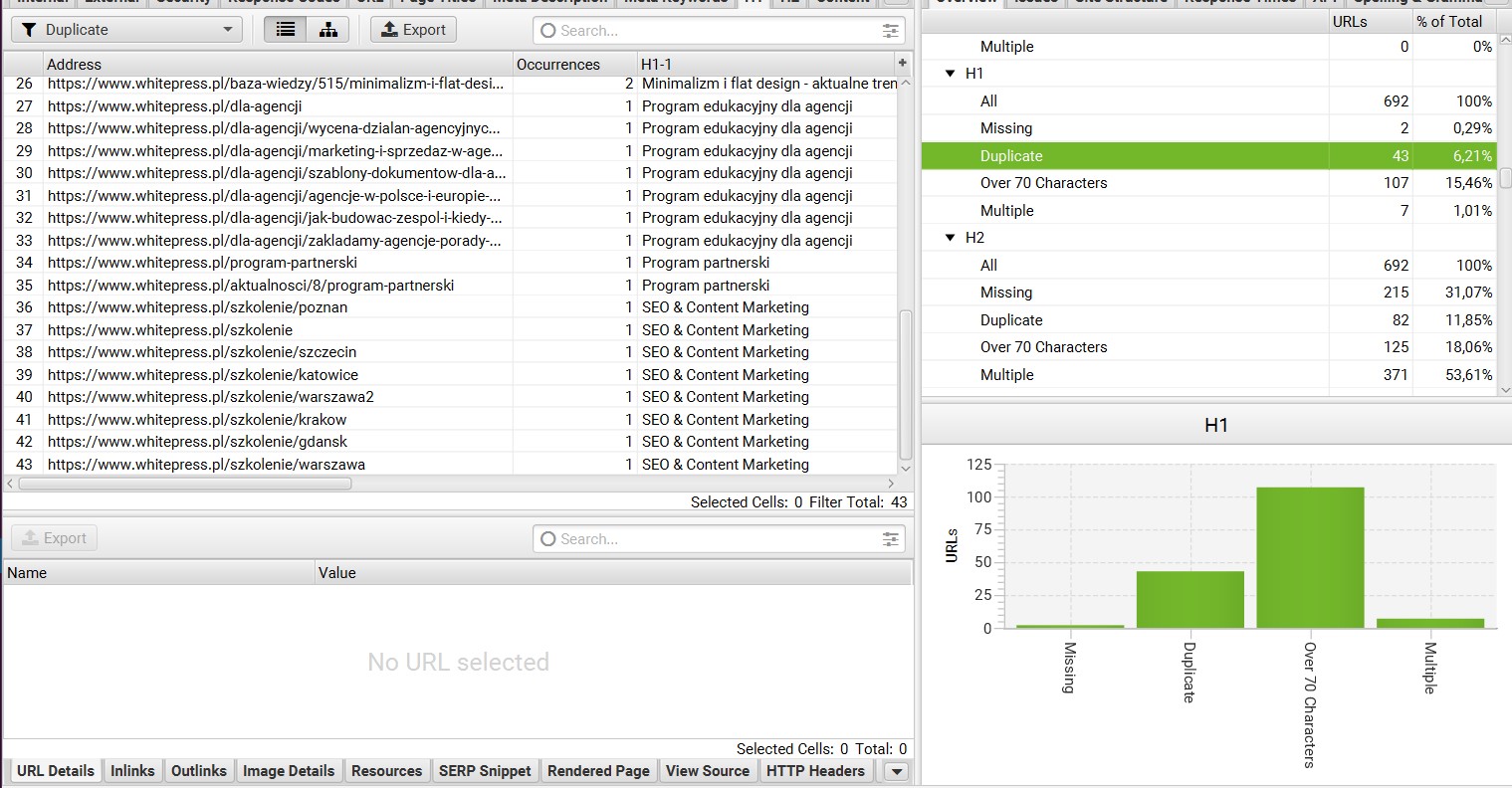

Nagłówki Hx

Możemy dzięki tym danych sprawdzić, jakie są nagłówki H1, H2 oraz czy nie ma problemu z niezagospodarowanymi nagłówkami lub ich duplikacją.

Obecność kodów odpowiedzi innych niż 200

W wyświetlanych tu danych widzimy, czy nie ma problemu z linkowaniem do usuniętych zasobów (zwracających kod 404) czy też adresów przekierowywanych na inny URL (zwracających kody 3xx).

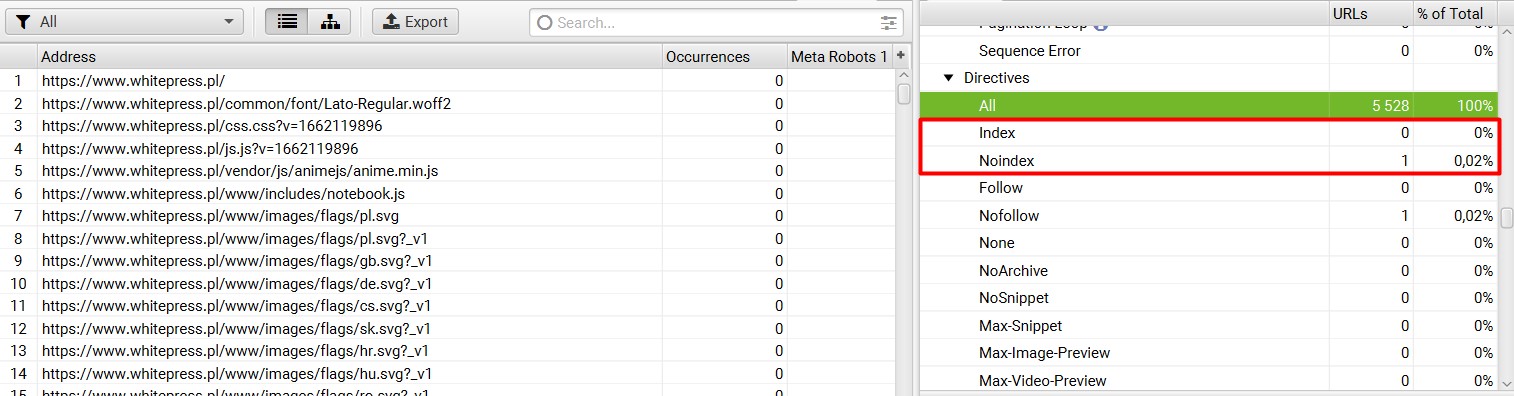

Dyrektywy robots np. NOINDEX

Analizując dyrektywy robots możemy dostrzec, czy część podstron (albo i całość) nie jest zablokowana przed indeksowaniem. Myślę, że każdy doświadczony SEOwiec przynajmniej raz w życiu zauważył tam obecność tagu NOINDEX, o którym właściciel serwisu nie miał pojęcia.

Najczęściej występującym powodem tego faktu jest przeprowadzana migracja. Tagiem tym blokujemy przed zaindeksowaniem środowisko testowe nowej strony, a po migracji należy go usunąć. Czasami zdarza się, że nikt nie pamięta o tym fakcie i domena, na której zmieniono stronę - po pewnym czasie - jest usunięta z indeksu Google.

Kiedy Screaming Frog jest przydatny?

Użycie crawlerów przydaje się na wielu etapach działań ze stroną. Najczęściej klienci słyszą o konieczności użycia crawlera podczas rozpoczęcia działań SEO, audytu SEO oraz podczas migracji serwisu. Faktem jest, że są to dość istotne momenty, w których te dane należy dokładnie przeanalizować. Mimo ogromu pseudo audytorów online, które „udają” bycie substytutem szczegółowego audytu SEO - większość klientów rozumie potrzebę skorzystania z crawlera takiego jak Screaming Frog oraz dokładnej analizy tych danych przez doświadczonego specjalistę SEO.

Czy są to jednak jedyne momenty, gdy warto korzystać z tego narzędzia? Absolutnie nie! Podczas wyceny działań SEO w Digone niejednokrotnie wykorzystujemy SF do wstępnej weryfikacji, czy nie ma jakiś ogromnych problemów ze stroną.

Po pierwsze poprawa ich daje nam szansę na quick wins i przekonania klienta do dalszego inwestowania w SEO.

Po drugie mamy szansę wykazać, że przykładamy wagę do wycen działań i zwracamy uwagę na dobro klienta.

Klient, który podczas wyceny działań słyszy, że dostrzegliśmy tag NOINDEX i widzimy, że spowodowało to ogromne spadki widoczności - przekonuje się, że ma do czynienia z profesjonalistami i jest wdzięczny, że już teraz pomagamy ratować widoczność serwisu. Zdarza się również, że to już n-ta wycena i nikt nie zwrócił uwagi, że już teraz strona wymaga pilnej interwencji.

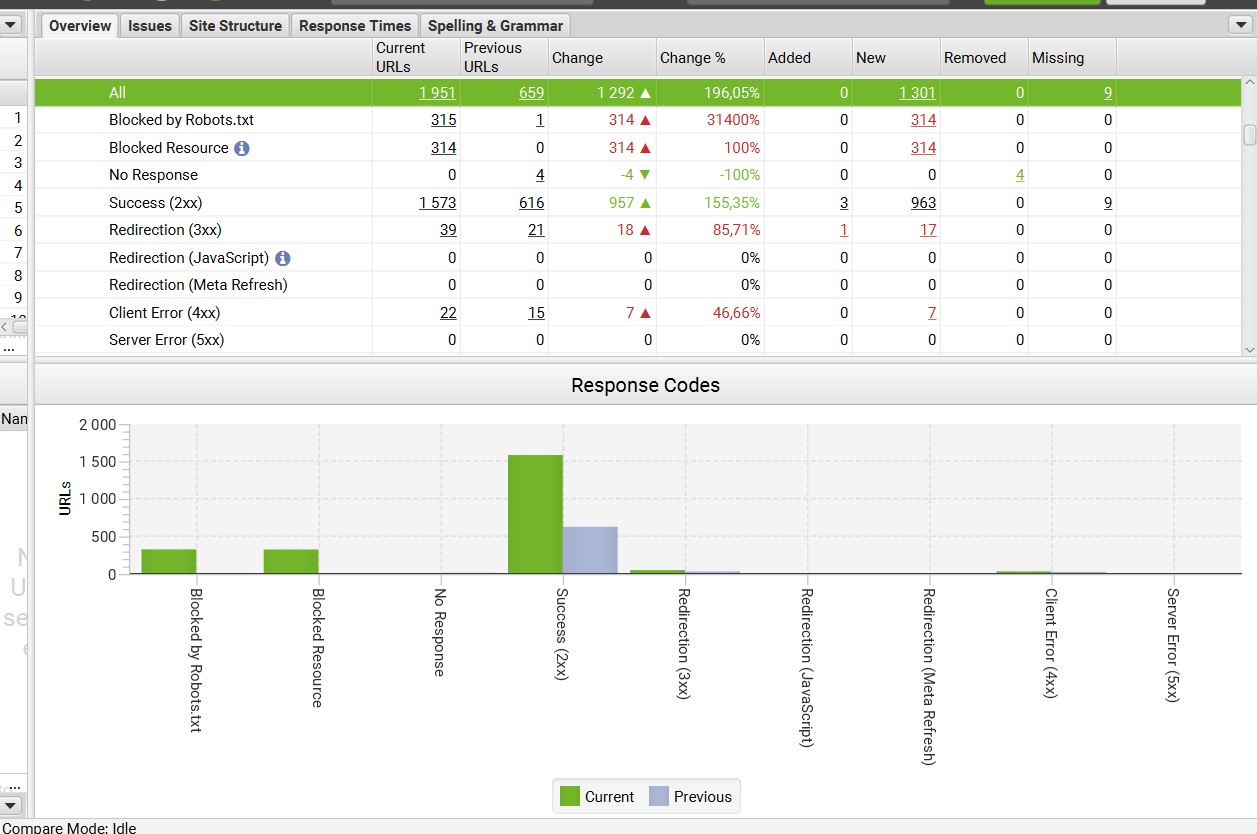

Cykliczne porównywanie danych

Narzędzie Screaming Frog umożliwia nam także porównywanie danych - pomiędzy poszczególnymi crawlami serwisu, obecnym i archiwalnym.

Dlaczego zawsze rekomenduję takie cykliczne crawlowanie serwisu? Strony internetowe - szczególnie duże i sklepy e-commerce - cały czas „żyją” i do tego są cyklicznie rozbudowywane, zmieniane. Zdarza się, że z pozoru niewielka zmiana czy też aktualizacja silnika strony - potrafią wiele namieszać w elementach, które są istotne w SEO.

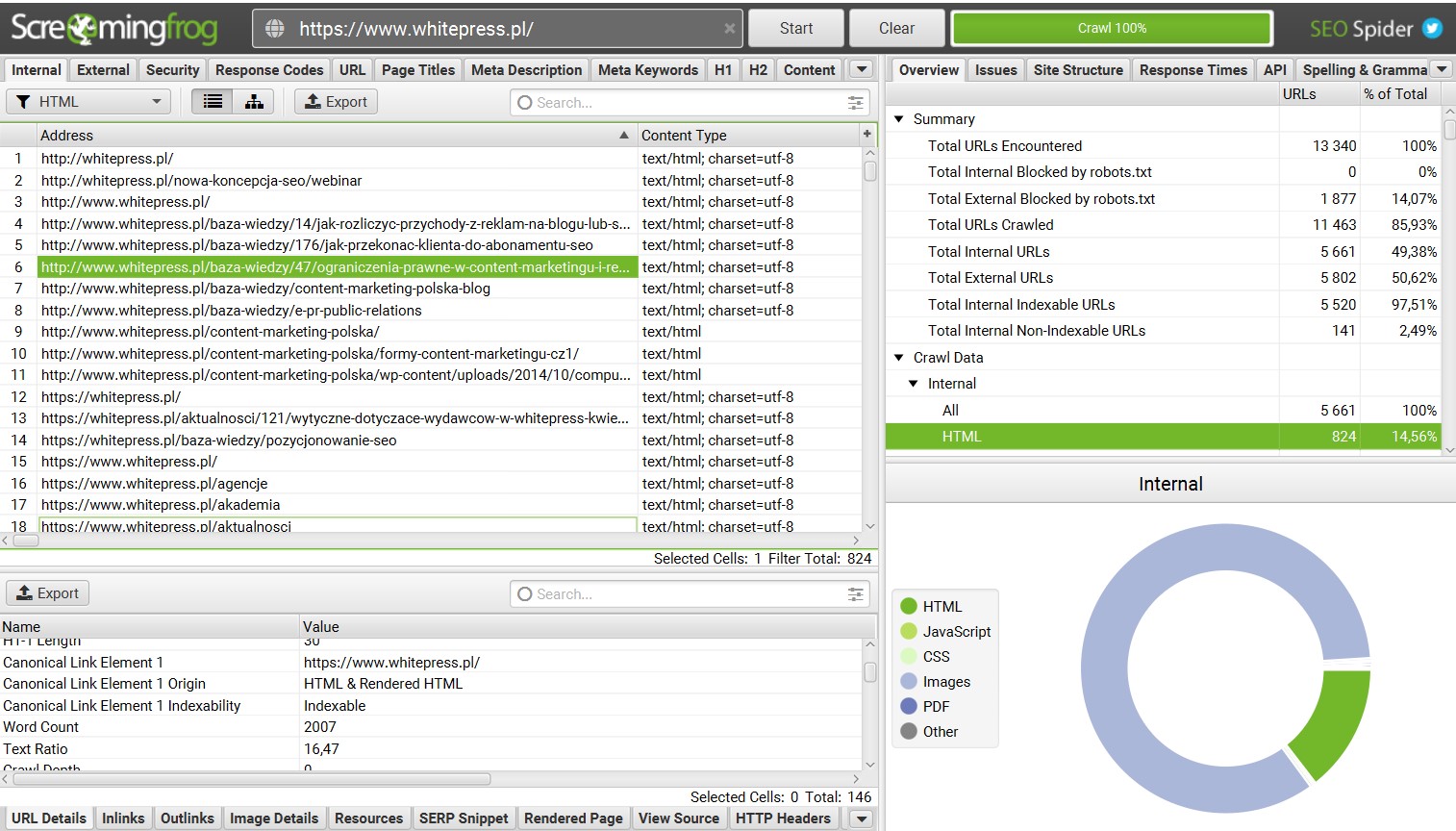

Wizualizacja danych

Dane z Screaming Frog’a możemy przedstawić nie tylko w formie tabel lub wyeksportowanych XLSów. Część danych można zwizualizować w postaci grafik.

Oto kilka wizualnych widżetów w Screaming Frog’u:

Chmura słów użytych w treści danej podstrony.

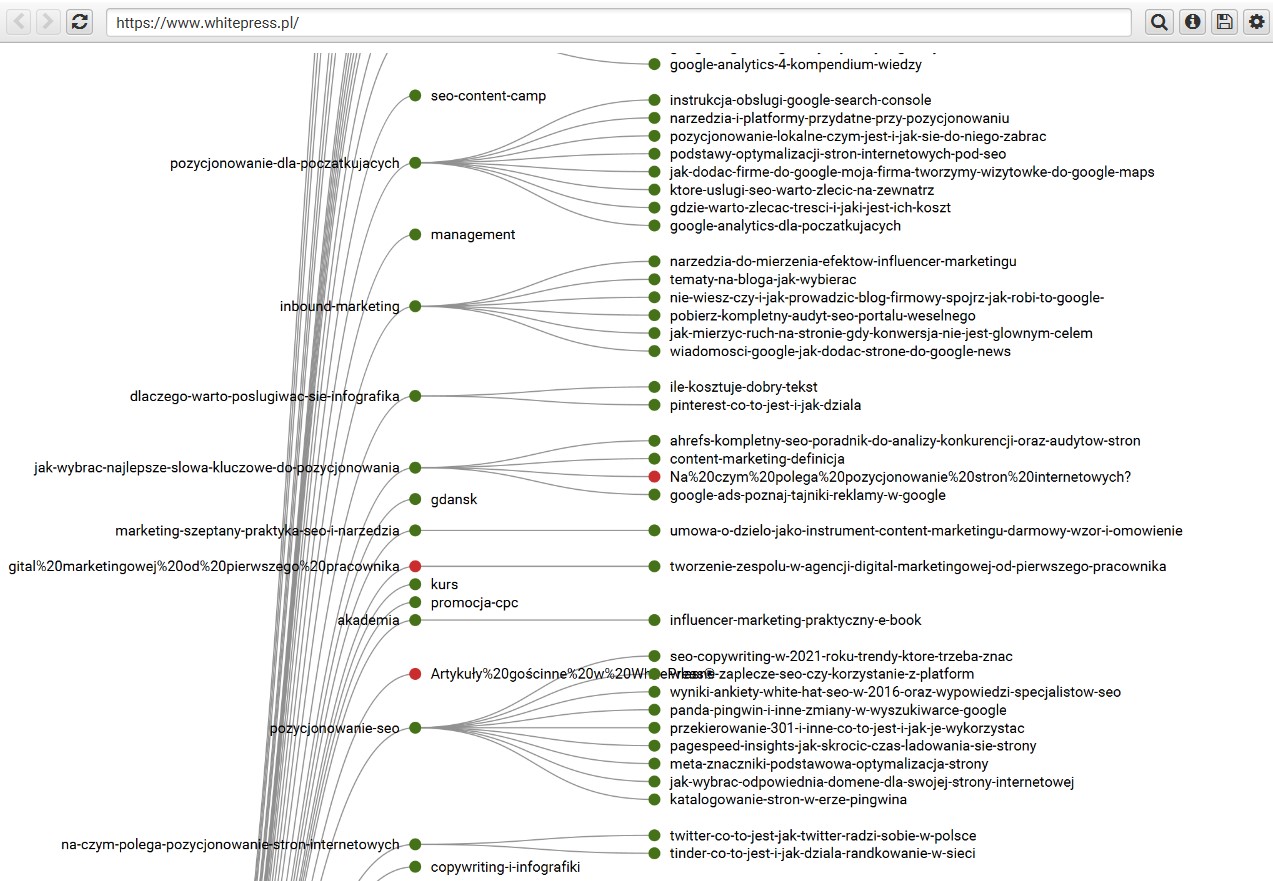

Część grafu umiejscowienia podstron w strukturze serwisu.

Podsumowanie

Screaming Frog to jeden z kilku dość popularnych crawlerów SEO. W przypadku niedużych oraz średnich sprawdza się idealnie - do 500 analizowanych zasobów można go używać za darmo, a nawet zakup licencji rocznej nie jest wielkim wydatkiem (na tle kosztów części narzędzie SEO). Na dzień pisania artykułu 1 licencja SF to koszt około 200 dolarów. To właśnie nieduży koszt i czytelność działania powoduje popularność tego narzędzia.